L'IA? In ambito cybersecurity è un'arma a doppio taglio. Il punto di Bitdefender

di Alberto Falchi pubblicata il 03 Agosto 2023, alle 15:31 nel canale Security

I criminali hanno già iniziato a usare l'IA generativa per automatizzare gli attacchi e scrivere velocemente nuovi malware. Le aziende non possono limitarsi a guardare: è ora di introdurre l'IA anche per difendere i propri sistemi

L'intelligenza artificiale generativa è uno strumento che può essere adattato a svariati ambiti. La creazione di testi e immagini, il supporto al cliente, la scrittura di codice. Non mancano esempi di utilizzo per scopi meno nobili, come la scrittura di malware o l'automazione di alcune operazioni per velocizzare gli attacchi informatici.

"I modelli linguistici di grandi dimensioni come ChatGPT hanno reso più facile che mai per i criminali informatici creare rapidamente e-mail di phishing e attacchi di social engineering sofisticati e dall'aspetto autentico", spiega Richard De La Torre, Technical Marketing Manager di Bitdefender. "Poiché questi strumenti sono in grado di generare istantaneamente testi colloquiali redatti dall’uomo, gli hacker sono in grado di imitare in modo convincente lo stile di comunicazione di persone o aziende fidate, aumentando così l'efficacia dei loro attacchi"

Scalare gli attacchi con ChatGPT

.jpg)

Riuscire a violare le difese informatiche di un'azienda non è sempre semplice, ma l'avvento di ChatGPT ha reso possibile anche a criminali con poche conoscenze tecniche di fare ciò che prima avrebbe richiesto parecchio studio. I sistemi di IA generativa, infatti, facilitano enormemente la scrittura di codice, permettendo di realizzare in pochi minuti varianti di malware, rendendole più efficaci e più difficili da scoprire per gli antivirus.

In teoria, i Large Language Model sono strutturati in modo da non poter essere utilizzati per questi scopi, ma come confermano i ricercatori di Bitdefender, è possibile superare le limitazioni imposte dagli sviluppatori. "Utilizzando strumenti di intelligenza artificiale generativa per semplificare lo sviluppo di malware e automatizzare la distribuzione dei loro attacchi, i gruppi di criminali informatici possono aumentare la loro frequenza e gettare una rete più ampia per colpire un maggior numero di potenziali vittime", sottolinea De La Torre.

ChatGPT a supporto dei team di sicurezza

Fortunatamente, ChatGPT si rivela molto utile anche per chi gli attacchi li deve contrastare. Anche in questo caso, l'automazione di processi ripetitivi è uno dei suoi punti di forza.

"L'intelligenza artificiale può essere utilizzata per automatizzare il monitoraggio e l'analisi degli eventi e dei registri di sicurezza, identificando le anomalie nel comportamento e consentendo un rilevamento e una risposta più rapidi alle potenziali minacce. Gli algoritmi di apprendimento automatico possono essere addestrati per identificare schemi indicativi di attività dannose, liberando tempo prezioso per i professionisti della sicurezza informatica per l’indagine e la neutralizzazione delle minacce", sottolinea De La Torre.

L'IA a supporto della sicurezza informatica

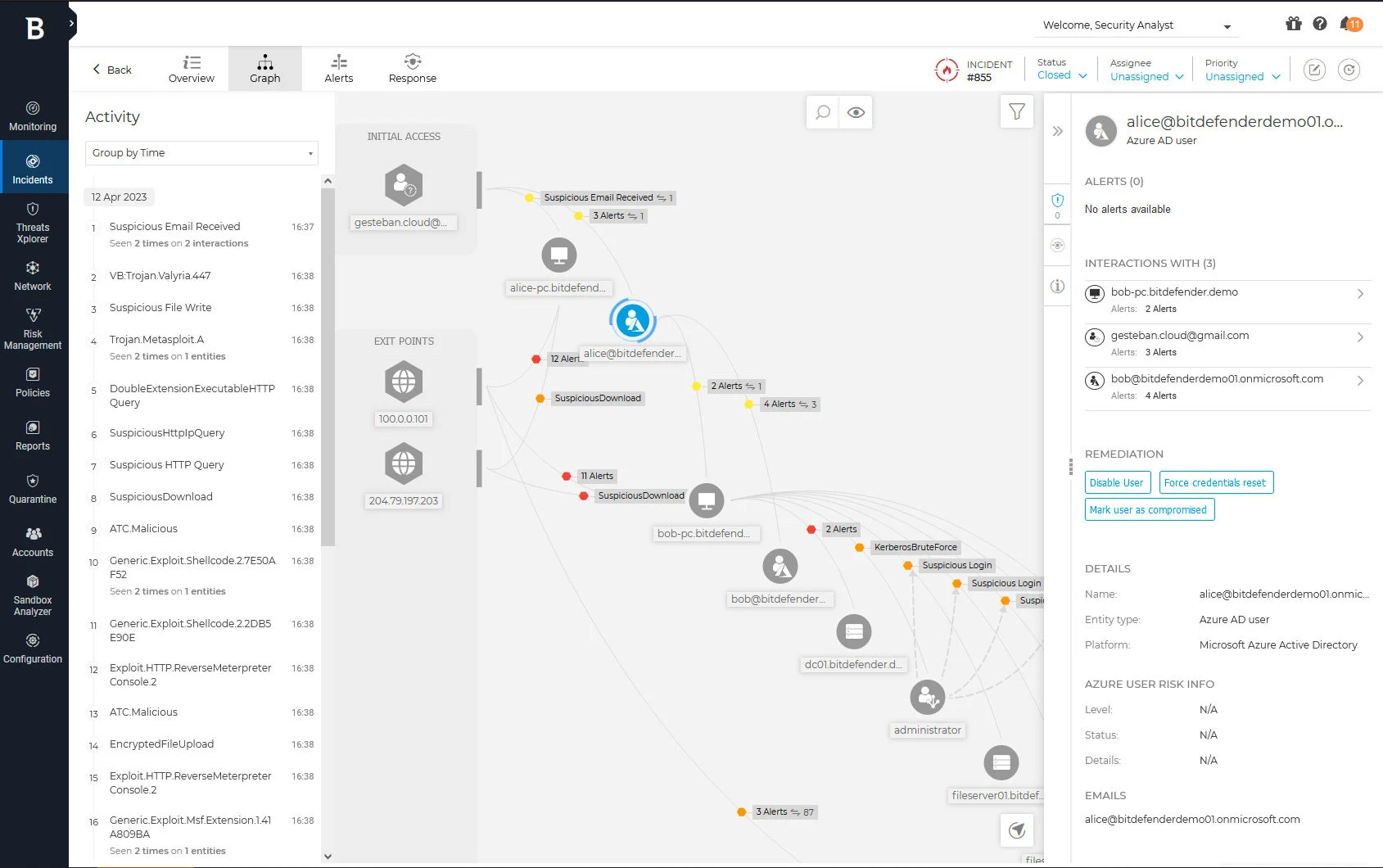

Bitdefender ha integrato IA e machine learning nelle sue soluzioni ancora prima del successo improvviso di ChatGPT e altre piattaforme. Un esempio è la piattaforma Bitdefender GravityZone eXtended Detection and Response (XDR), che sfrutta il machine learning per correlare e analizzare i dati provenienti dalla varie soluzioni di sicurezza installate in azienda. Informazioni che sono poi passate a GravityZone Incident Advisor, che presenta le informazioni in maniera comprensibile, suggerendo anche le azioni di mitigazione necessarie.

Secondo De la Torre, "le aziende devono adottare un approccio proattivo e multilivello alla sicurezza per rafforzare la loro resilienza informatica, a fronte della crescente diffusione delle tecnologie di intelligenza artificiale. Dovrebbero adottare le best practice per la formazione di sensibilizzazione alla sicurezza, per aiutare i dipendenti a comprendere la sofisticazione delle minacce odierne e come evitare di diventare vittime. Dovrebbero inoltre adottare tecnologie di sicurezza basate su intelligenza artificiale e machine learning, che possono anche assistere i team di sicurezza nel monitoraggio, nell'identificazione e nella risposta alle minacce".

Ryzen Threadripper 9980X e 9970X alla prova: AMD Zen 5 al massimo livello

Ryzen Threadripper 9980X e 9970X alla prova: AMD Zen 5 al massimo livello Acer TravelMate P4 14: tanta sostanza per l'utente aziendale

Acer TravelMate P4 14: tanta sostanza per l'utente aziendale Hisense M2 Pro: dove lo metti, sta. Mini proiettore laser 4K per il cinema ovunque

Hisense M2 Pro: dove lo metti, sta. Mini proiettore laser 4K per il cinema ovunque Xbox: dal prossimo mese verifica dell'identità obbligatoria in UK, in futuro anche in altre regioni

Xbox: dal prossimo mese verifica dell'identità obbligatoria in UK, in futuro anche in altre regioni Corsair AI Workstation 300: poco più grande di un Mini PC, ma con la potenza di un desktop

Corsair AI Workstation 300: poco più grande di un Mini PC, ma con la potenza di un desktop Addio a Elio Marioli, un pioniere della mobilità elettrica quando nessuno ne parlava

Addio a Elio Marioli, un pioniere della mobilità elettrica quando nessuno ne parlava

0 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoDevi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".