Mistral AI: il LLM Mistral Large è ora disponibile su Amazon Bedrock

di Alberto Falchi pubblicata il 04 Aprile 2024, alle 12:26 nel canale data

I clienti di AWS possono ora affidarsi a Mistral Large per articolare conversazioni, generare contenuti ricchi di sfumature e affrontare compiti di ragionamento complessi. È in grado di comunicare in inglese, francese, spagnolo, tedesco e italiano

Da oggi gli utenti di Amazon Bedrock hanno maggior libertà di scelta in ambito LLM: AWS ha infatti reso disponibile su Bedrock Mistral Large, il modello di IA dell'azienda francese Mistral AI. Disponibili anche i modelli Mistral 7B e Mixtral 8x7B.

Cosa è Mistral Large?

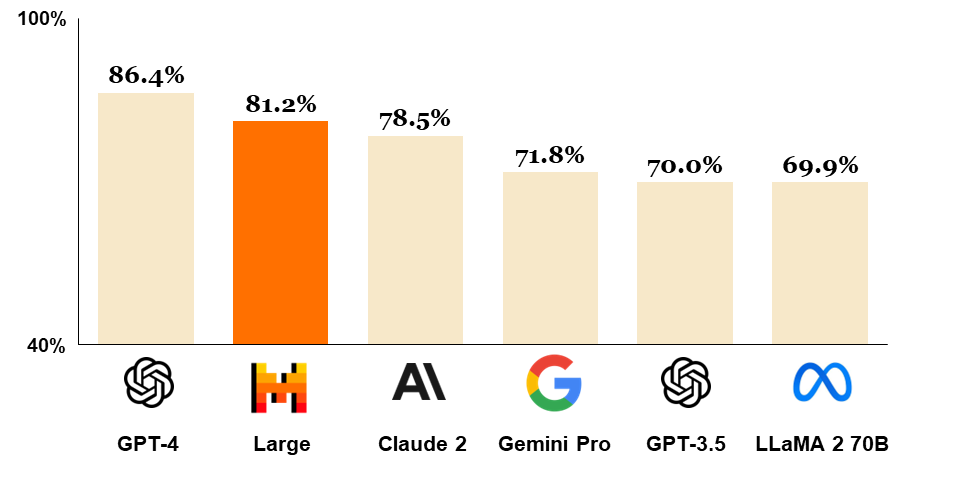

Mistral Large è un Large Language Model sviluppato per competere con modelli di IA evoluti come GPT-4. Al contrario della maggior parte degli LLM oggi disponibili, sviluppati negli USA, Mistral nasce in Europa, in Francia nello specifico. Mistral AI, l'azienda francese che lo ha sviluppato, è stata fondata da ex dipendenti di Meta e Deepmind.

Fra le caratteristiche la capacità di comunicare in inglese, francese, italiano, tedesco e spagnolo. È in grado di scrivere codice per vari linguaggi di programmazione e ha una finestra di contesto (context window) di 32.000 token. Può essere installato su piattaforme cloud così come on premise. Il modello di utilizzo di Mistral Large è a consumo.

Oltre a Mistral Large, tramite Amazon Bedrock sono accessibili anche i modelli open source Mistral 7B e Mixtral 8x7B, meno evoluti di Mistral Large in quanto utilizzano un minor numero di parametri.

Mistral AI sfrutterà la potenza dei chip per l'IA di AWS

La collaborazione fra Mistral AI e AWS non si limita a rendere disponibili i modelli dell'azienda francese sul cloud di Amazon. Mistral AI utilizzerà i chip Trainium e Inferentia di AWS, sviluppati per accelerare i calcoli dell'IA, nei prossimi foundation model che distribuirà su Amazon Bedrock.

“Portando i modelli di Mistral AI su Amazon Bedrock, i clienti avranno accesso alle tecnologie di IA generativa più evolute, oltre a un facile accesso a strumenti e funzionalità di livello enterprise, il tutto in un ambiente sicuro e privato”, afferma Vasi Philomin, VP of generative AI di AWS. “La capacità del team di Mistral AI di innovare in modo così rapido è davvero lodevole. Stiamo entusiasti di collaborare con loro per accelerare ulteriormente l'evoluzione della loro tecnologia rivoluzionaria.”

Microsoft Surface Pro 12 è il 2 in 1 più compatto e silenzioso

Microsoft Surface Pro 12 è il 2 in 1 più compatto e silenzioso Recensione REDMAGIC Astra Gaming Tablet: che spettacolo di tablet!

Recensione REDMAGIC Astra Gaming Tablet: che spettacolo di tablet!  Dopo un mese, e 50 foto, cosa abbiamo capito della nuova Nintendo Switch 2

Dopo un mese, e 50 foto, cosa abbiamo capito della nuova Nintendo Switch 2 Cyberpunk 2077 raggiungerà i 120 FPS su Mac con dettagli ultra: ecco specifiche e data d'uscita

Cyberpunk 2077 raggiungerà i 120 FPS su Mac con dettagli ultra: ecco specifiche e data d'uscita Questi nanorod potrebbero cambiare il futuro dell'energia pulita

Questi nanorod potrebbero cambiare il futuro dell'energia pulita realme C71: lentry-level con display 120 Hz, batteria infinita e NFC a meno di 150 euro

realme C71: lentry-level con display 120 Hz, batteria infinita e NFC a meno di 150 euro

3 Commenti

Gli autori dei commenti, e non la redazione, sono responsabili dei contenuti da loro inseriti - infoopus è meglio di gpt-4

sonnet è tra gpt-3.5 e gpt-4 (più vicino al 4), ma al prezzo del 3.5

haiku costa una frazione, va come una scheggia e performa circa come gpt-3.5 ma costa pochissimo

opus è meglio di gpt-4

sonnet è tra gpt-3.5 e gpt-4 (più vicino al 4), ma al prezzo del 3.5

haiku costa una frazione, va come una scheggia e performa circa come gpt-3.5 ma costa pochissimo

Sapresti indicarmi dei portali affidabili dove seguire queste evoluzioni?

Grazie per l'info sia per IA che per la scala delle attuali IA.

Devi effettuare il login per poter commentare

Se non sei ancora registrato, puoi farlo attraverso questo form.

Se sei già registrato e loggato nel sito, puoi inserire il tuo commento.

Si tenga presente quanto letto nel regolamento, nel rispetto del "quieto vivere".